Ο Islam Nour χρησιμοποιεί, εδώ και αρκετό καιρό, την τεχνητή νοημοσύνη (AI) για να δημιουργήσει τα έργα του.

Ο σχεδιαστής, με έδρα την Κίνα, έχει πάνω από 50.000 ακόλουθους στα μέσα κοινωνικής δικτύωσης. Πρόσφατα, το μεγαλύτερο μέρος της δουλειάς του έχει επικεντρωθεί στη σύγκρουση που βρίσκεται σε εξέλιξη στη Γάζα.

«Ο στόχος μου δεν είναι τόσο να επηρεάσω τους ανθρώπους όσο να εκφράσω τα συναισθήματά μου και να προβάλω τον πόνο στη Γάζα», δήλωσε ο Nour στο SBS Examines.

«Πάντα προσπαθώ να μην ωραιοποιώ τον πόνο ή να ελαχιστοποιώ την έκτασή του, αλλά να τον εξηγώ όσο το δυνατόν περισσότερο».

ΑΚΟΥΣΕ

SBS Examines: Τι είναι η παραπληροφόρηση;

SBS Greek

24/09/202404:34

Πολλές από τις εικόνες του Nour έχουν προκαλέσει αντιδράσεις έπειτα από την αναδημοσίευσή τους στα μέσα κοινωνικής δικτύωσης, χωρίς να αναγνωρίζεται η προέλευσή τους από το AI.

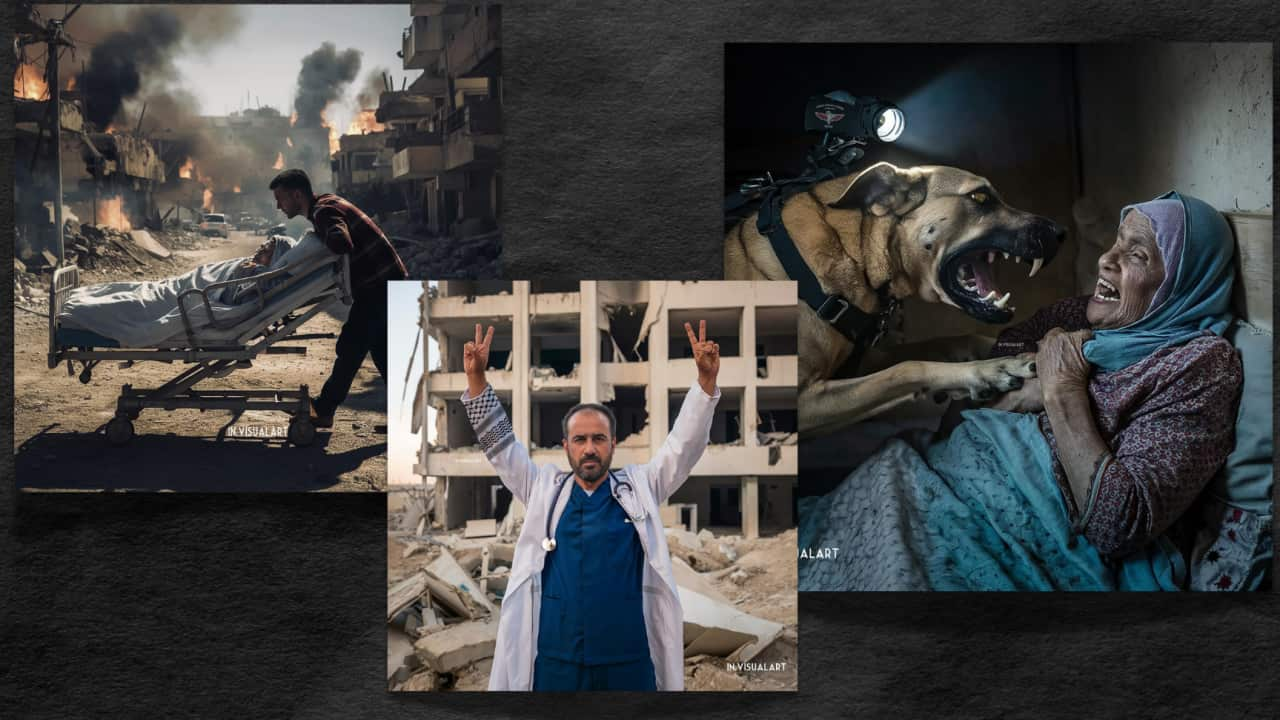

Μια εικόνα που κυκλοφόρησε αρκετά, απεικόνιζε την απελευθέρωση του Dr. Mohammed Abu Selmia, παιδιάτρου και διευθυντή του νοσοκομείου al-Shifa στη Γάζα.

Η εικόνα χρησιμοποιήθηκε με διάφορους τρόπους: είτε επικρίνοντας την απελευθέρωση του γιατρού, είτε επαινώντας την επιστροφή στην εργασία του.

Μια άλλη εικόνα του Nour, που δείχνει έναν σκύλο να επιτίθεται σε μια ηλικιωμένη γυναίκα κατά τη διάρκεια μιας στρατιωτικής επιχείρησης, έφτασε σε περισσότερους από ένα εκατομμύριο χρήστες.

Islam Nour's AI-generated artwork which has recently gone viral. Credit: @in.visualart

«Οι εικόνες που δημιουργούνται από την τεχνητή νοημοσύνη, όσο έντονες, δυνατές ή εκφραστικές κι αν είναι, δεν μπορούν να συγκριθούν με τις φρικτές εικόνες που βλέπουμε από τη Γάζα», δήλωσε ο Nour.

Ο ίδιος αναγνωρίζει την ευθύνη του ως καλλιτέχνης, λέγοντας ότι έχει «ηθικό καθήκον να μην λέει ψέματα ή να μην κατασκευάζει γεγονότα».

Έχοντας αυτό κατά νου, συχνά μοιράζεται πραγματικές εικόνες και βίντεο από πολίτες δίπλα στις δημιουργίες του από την τεχνητή νοημοσύνη.

«Είναι αναγκαίο να δημοσιεύουμε τις πραγματικές εικόνες και τα βίντεο», σημείωσε.

Διάβασε περισσότερα

Πως η παραπληροφόρηση κλιμάκωσε την βία στο Ηνωμένο Βασίλειο

Οι δημιουργικές δυνατότητές για παραπληροφόρηση

Ο Αυστραλός φωτορεπόρτερ Andrew Quilty έζησε και εργάστηκε στο Αφγανιστάν για εννέα χρόνια.

Πιστεύει ότι το παραδοσιακό φωτορεπορτάζ προσφέρει μια πιο προσγειωμένη οπτική.

«Η καταγραφή από το πεδίο της μάχης προσφέρει μεγαλύτερη κατανόηση», εξήγησε ο Quilty.

Πιστεύει ότι οι εικόνες πολέμου που δημιουργούνται με την τεχνητή νοημοσύνη είναι επικίνδυνες και τις παρομοιάζει με τη «χρήση ενός σκιτσογράφου της Disney για να απεικονίσει γεγονότα τόσο σοβαρά όσο αυτά στις εμπόλεμες ζώνες».

A self-portrait of Australian photojournalist Andrew Quilty during his time working and living in the Middle East. Credit: Andrew Quilty

«Ένας φωτογράφος βασίζεται στην καλή του φήμη... ενώ δεν υπάρχει καμία επιβολή που να αποτρέπει κάποιον που χρησιμοποιεί τα μέσα κοινωνικής δικτύωσης από το να δημιουργήσει μια εικόνα που ταιριάζει στην αφήγησή του», ανέφερε.

Αλλά ο Quilty πιστεύει, επίσης, ότι καμία φωτογραφία δεν είναι απολύτως αντικειμενική.

«Η φωτογράφιση σε εμπόλεμες ζώνες δεν αποκλείει την πιθανότητα να δημιουργηθεί προκατάληψη ή παραπληροφόρηση», τόνισε.

Η ηθική της Τεχνητής Νοημοσύνης

Η αναπληρώτρια καθηγήτρια οπτικής επικοινωνίας στο Πανεπιστήμιο Τεχνολογίας του Σύδνεϋ, Cherine Fahd, συμφωνεί ότι η αντικειμενικότητα είναι αρκετά πολύπλοκη.

«Η ιδέα της αυθεντικότητας σε μια φωτογραφία είναι κατά κάποιο τρόπο μυθοπλασία, επειδή μια φωτογραφία είναι ένα κλάσμα του δευτερολέπτου στο χρόνο που παρουσιάζεται από την οπτική γωνία ενός και μόνο ατόμου», δήλωσε.

Η αναπληρώτρια καθηγήτρια Fahd βλέπει επίσης τις θεραπευτικές ιδιότητες των εικόνων της τεχνητής νοημοσύνης.

«Η τεχνητή νοημοσύνη μπορεί να χρησιμοποιηθεί για να εξαπατήσει τους ανθρώπους, αλλά μπορεί επίσης να μας βοηθήσει να θρηνήσουμε», εξήγησε.

Διάβασε περισσότερα

SBS Ελληνικά

Καθώς αναπτύσσεται η τεχνητή νοημοσύνη, αναπτύσσεται και η συζήτηση γύρω από τον αντίκτυπό της.

Παρόλο που οι εικόνες που δημιουργούνται με τεχνητή νοημοσύνη δεν είναι φωτογραφίες με την παραδοσιακή έννοια του όρου, εξακολουθούν να δημιουργούνται από φωτογραφίες.

Η αναπληρώτρια καθηγήτρια Fahd δεν πιστεύει ότι η τεχνητή νοημοσύνη αποτελεί από μόνη της απειλή.

«Η ιδέα ότι η τεχνητή νοημοσύνη θα σημάνει την καταστροφή μας - δεν μπορώ να συμφωνήσω με κάτι τέτοιο», δήλωσε.

«Αυτό που έχει σημασία είναι ότι έχουμε επίγνωση του τι κάνει η τεχνολογία».